本篇总结python爬虫的重要框架——Scrapy。

Scrapy爬虫框架介绍

Scrapy是一个快速功能强大的网络爬虫框架。

Scrapy的安装

以管理员身份运行Scrapy平台,输入以下命令即可。

1 | pip install scrapy |

Scrapy爬虫框架结构

Scrapy不是一个函数功能库,而是一个爬虫框架。

什么是爬虫框架?

- 爬虫框架是实现爬虫功能的一个软件结构和功能组件集合。

- 爬虫框架是一个半成品,能够帮助用户实现专业网络爬虫。

5+2 结构

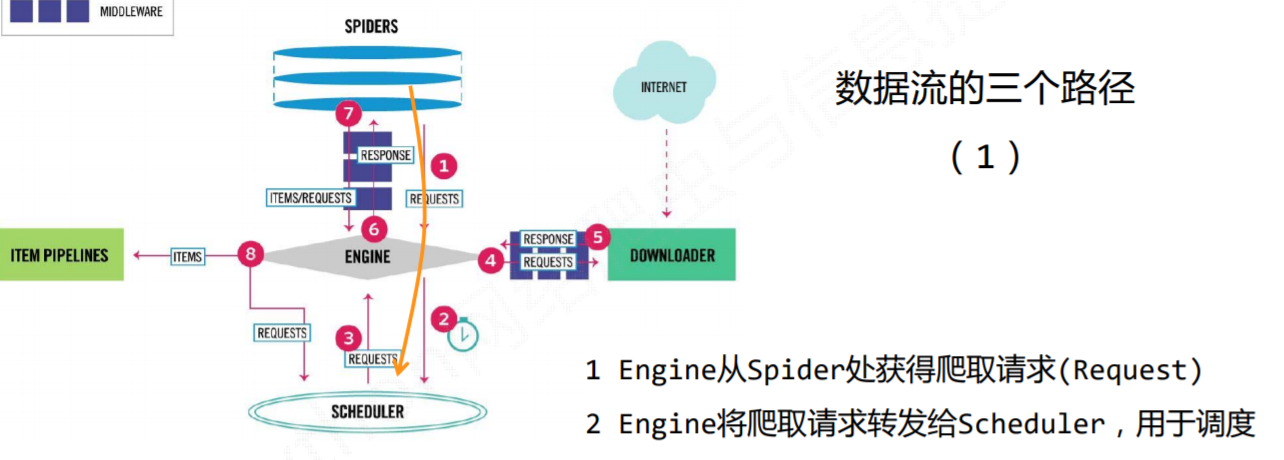

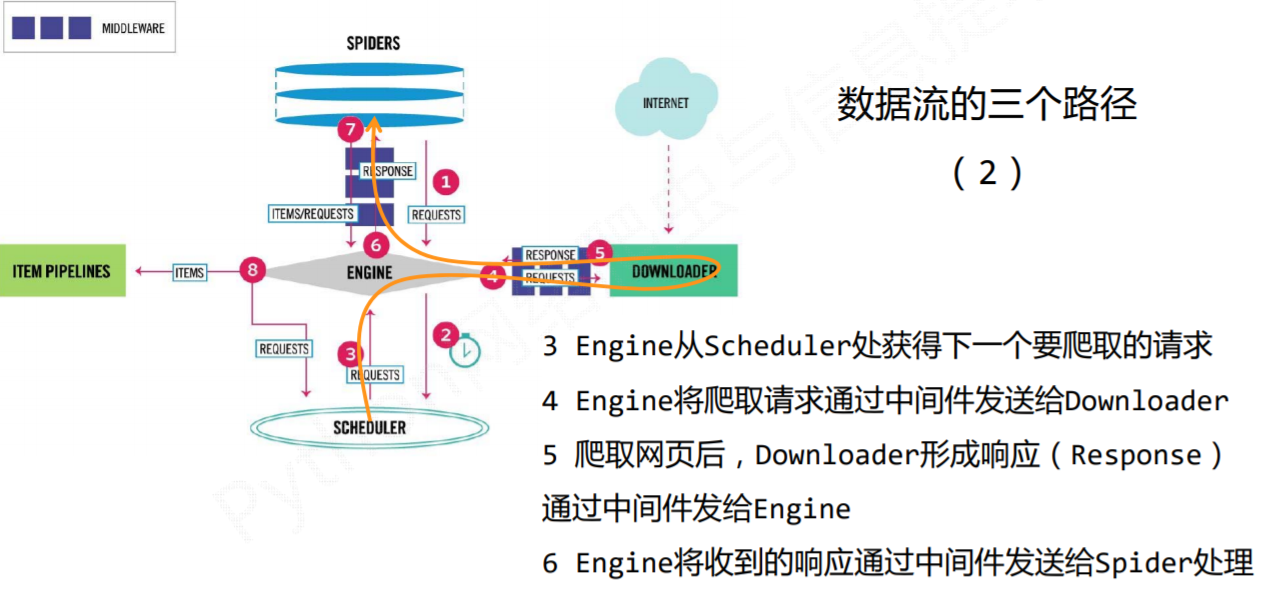

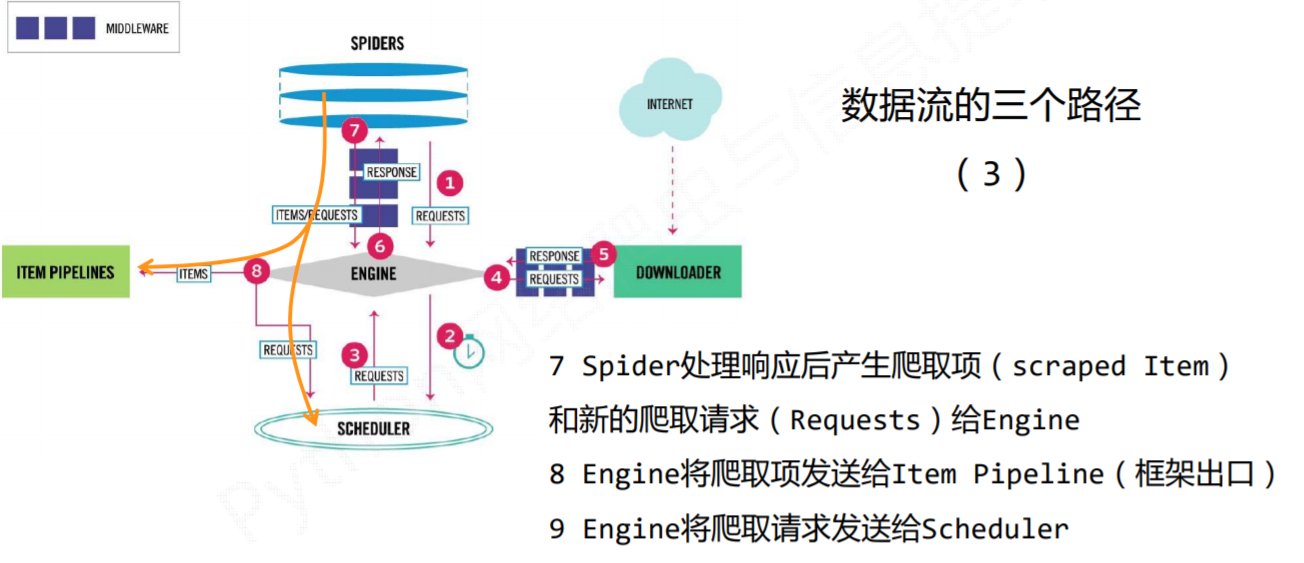

数据流的三种路径

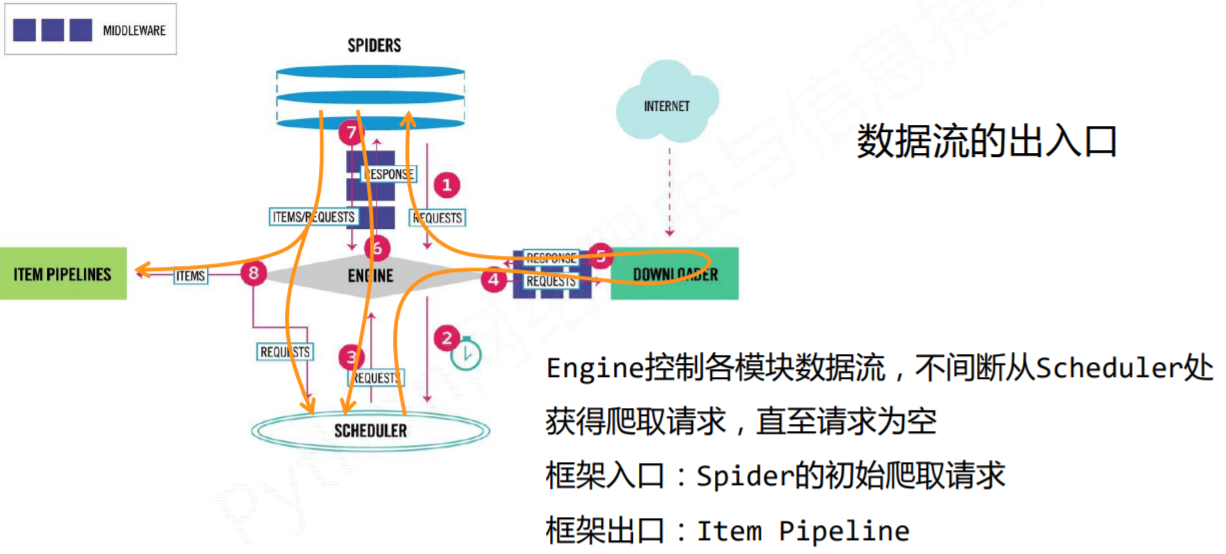

数据流的出入口

需要注意的是:scrapy的五个模块中,DOWNLOADER、SCHEDULER和ENGINE三个已经实现,用户只需编写配置SPIDERS和ITEM PIPELINES两个模块即可。

Scrapy爬虫框架解析

主要是对五个模块和两个中间键。

Engine

(1) 控制所有模块之间的数据流

(2) 根据条件触发事件

不需要用户修改

Downloader

根据请求下载网页 不需要用户修改

Scheduler

对所有爬取请求进行调度管理 不需要用户修改

Downloader Middleware

目的:实施Engine、Scheduler和Downloader 之间进行用户可配置的控制

功能:修改、丢弃、新增请求或响应

用户可以编写配置代码

Spider

(1) 解析Downloader返回的响应(Response)

(2) 产生爬取项(scraped item)

(3) 产生额外的爬取请求(Request)

需要用户编写配置代码

Item Pipelines

(1) 以流水线方式处理Spider产生的爬取项

(2) 由一组操作顺序组成,类似流水线,每个操 作是一个Item Pipeline类型

(3) 可能操作包括:清理、检验和查重爬取项中 的HTML数据、将数据存储到数据库

需要用户编写配置代码

Spider Middleware

目的:对请求和爬取项的再处理

功能:修改、丢弃、新增请求或爬取项

用户可以编写配置代码

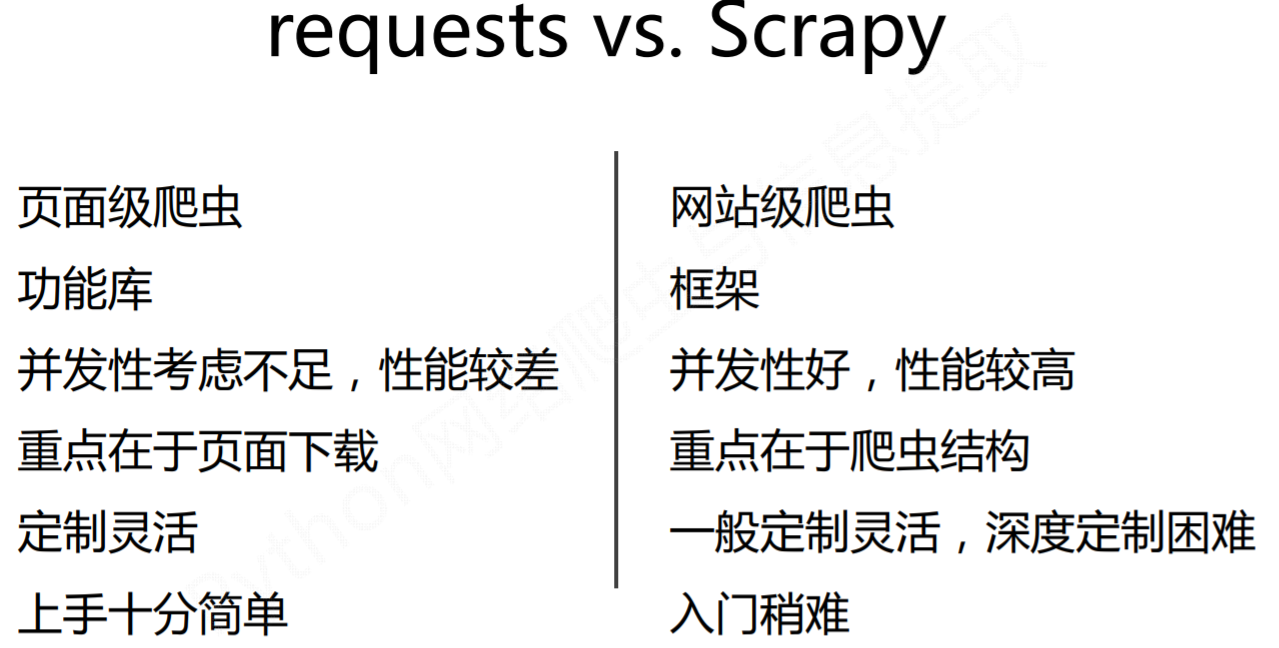

requests库和Scrapy爬虫的比较

相同点:

两者都可以进行页面请求和爬取,Python爬虫的两个重要技术路线

两者可用性都好,文档丰富,入门简单

两者都没有处理js、提交表单、应对验证码等功能(可扩展)

不同点

如何选择呢?

面临一个爬取需求,我们该选用requests库还是Scrapy库呢?

- 非常小的需求,requests库

- 不太小的需求,Scrapy框架

- 定制程度很高的需求(不考虑规模),自搭框架,requests > Scrapy

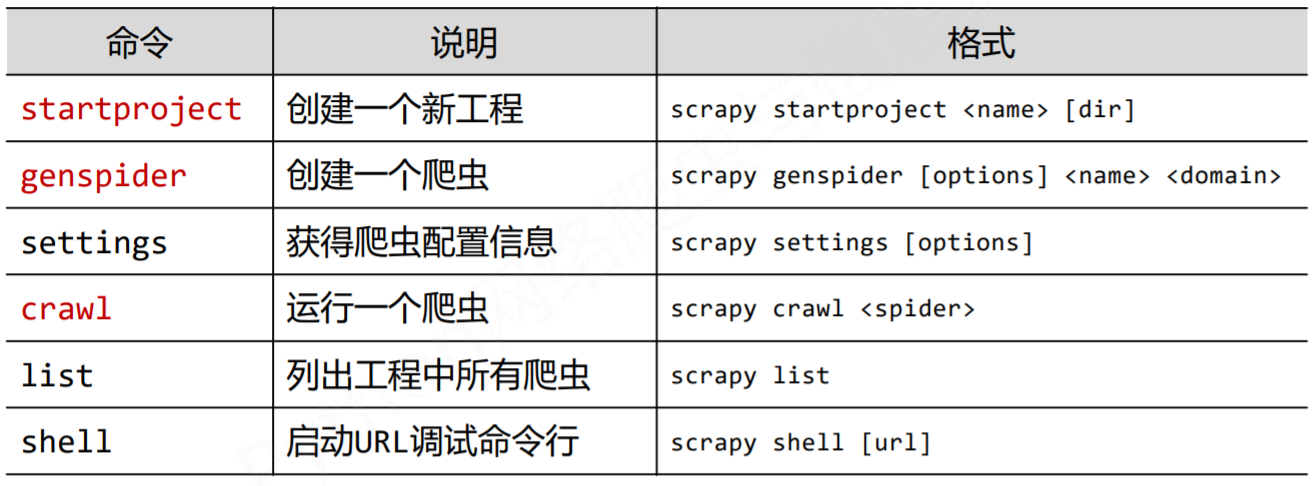

Scrapy爬虫的常用命令

Scrapy是为持续运行设计的专业爬虫框架,提供操作的Scrapy命令行,主要通过cmd命令行实现。

Scrapy命令行格式

1 | >scrapy <command> [options] [args] |

Scrapy常用命令

为什么Scrapy采用命令行创建和运行爬虫?

命令行(不是图形界面)更容易自动化,适合脚本控制

本质上,Scrapy是给程序员用的,功能(而不是界面)更重要